大数据分析全流程详解 从原始数据到智能洞察的数据处理服务

在当今数据驱动的时代,大数据分析已成为企业决策、产品优化和市场竞争的核心驱动力。一个完整、高效的大数据分析流程能够将海量、杂乱的数据转化为有价值的洞察,为企业创造竞争优势。本文将系统性地介绍大数据分析的标准流程,并阐述各环节中数据处理服务的关键作用。

一、大数据分析的核心流程

一个标准化的大数据分析流程通常包含以下六个关键阶段,它们环环相扣,形成一个从数据源到商业价值的闭环。

1. 业务理解与目标定义

* 内容:这是分析工作的起点,旨在明确“为什么要分析”和“分析要解决什么问题”。需要与业务部门紧密合作,将模糊的业务需求转化为清晰、可量化的分析目标(例如:提升客户留存率10%、降低运营成本15%)。

- 数据处理服务的作用:专业的数据服务团队在此阶段提供咨询服务,帮助客户精准定义数据需求,并规划实现目标所需的数据类型、来源和技术路径。

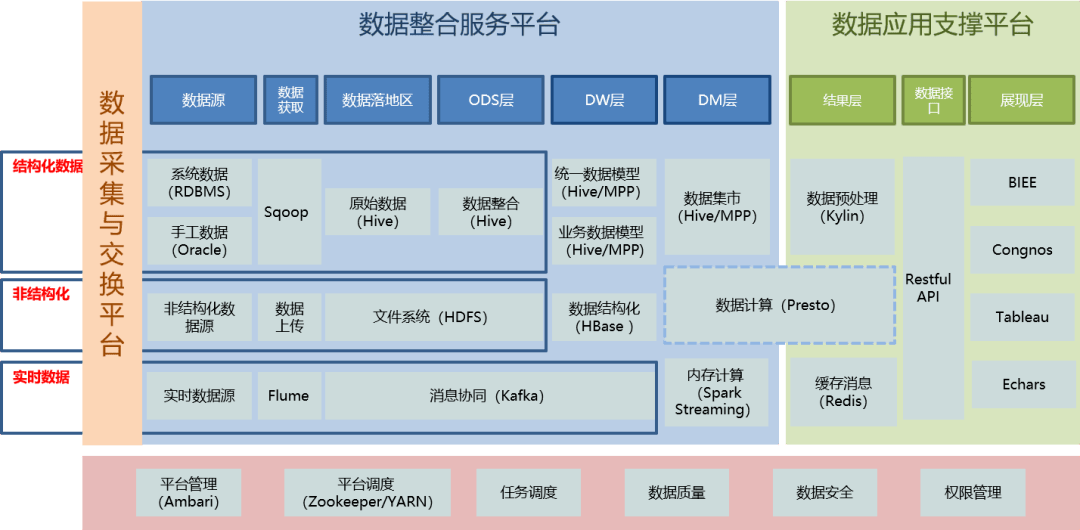

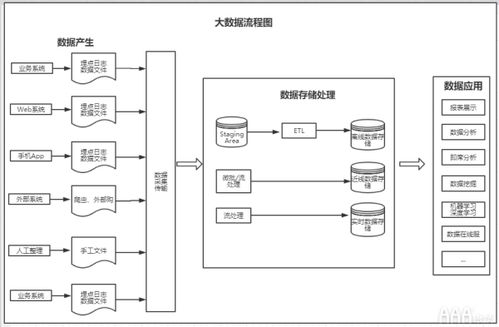

2. 数据采集与集成

* 内容:根据目标,从各种内外部数据源(如数据库、日志文件、传感器、社交媒体、第三方API)中收集原始数据。数据可能以结构化(数据库表格)、半结构化(JSON、XML)或非结构化(文本、图像、视频)形式存在。

- 数据处理服务的作用:提供高效、稳定的数据采集工具和平台(如Flume, Kafka, Sqoop),建立实时或批量的数据管道,将分散、异构的数据汇聚到统一的存储平台,为后续处理奠定基础。

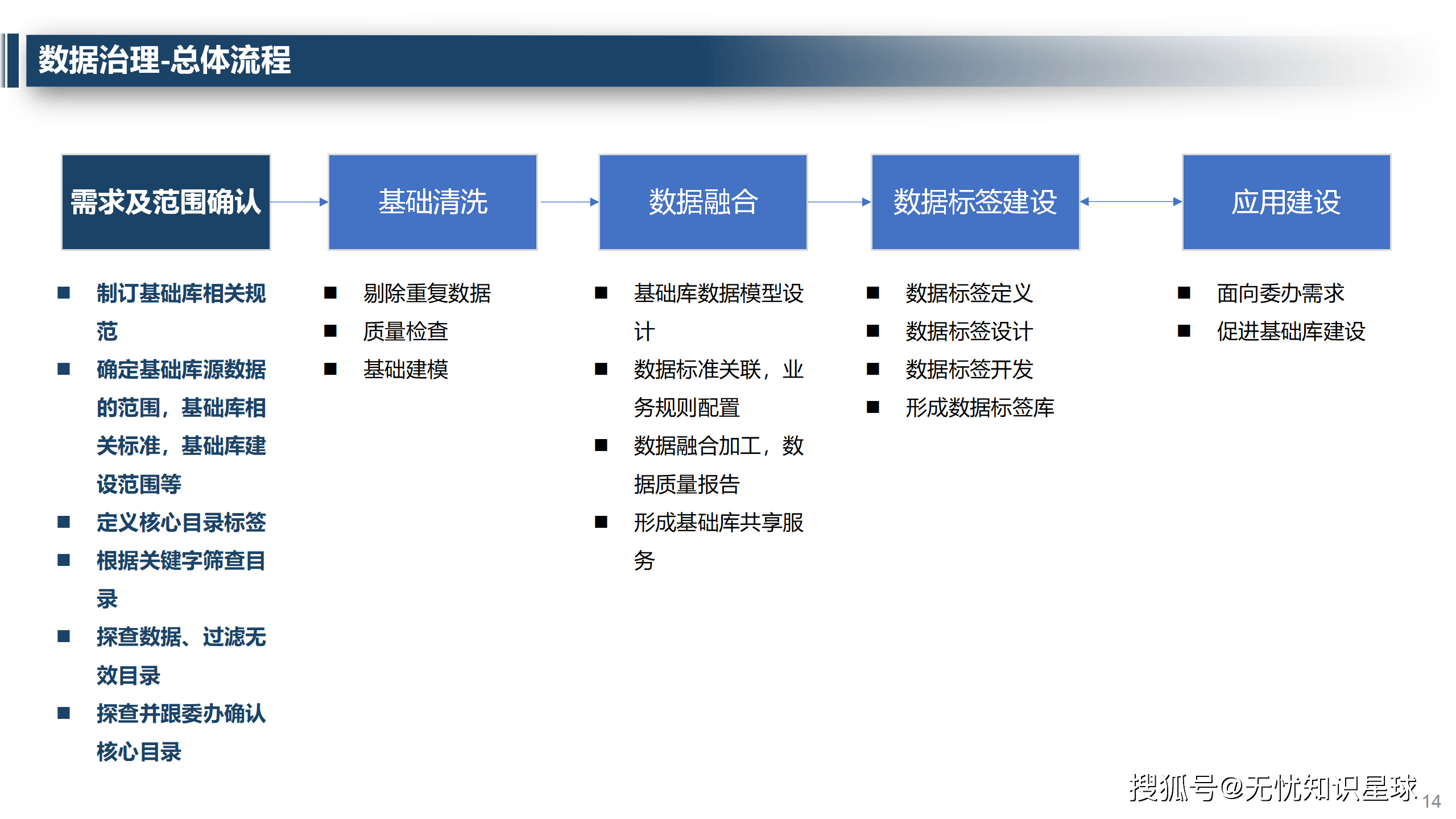

3. 数据预处理与清洗

* 内容:这是确保数据质量的核心环节,通常占据整个分析项目60%-80%的时间。主要任务包括:

- 清洗:处理缺失值、异常值、重复记录。

- 转换:格式化数据、标准化/归一化数值、数据离散化。

- 集成与规约:合并多源数据,通过抽样、特征选择等方式降低数据规模,提升后续处理效率。

- 数据处理服务的作用:提供自动化的数据清洗工具(如使用Python的Pandas、Spark DataFrame)和制定数据质量规则,建立可复用的数据清洗流水线,确保输入到模型的数据是干净、一致、可靠的。

4. 数据存储与管理

* 内容:将清洗后的数据存储在适合的系统中,以便高效访问和分析。根据数据特点和应用场景,可能采用数据仓库(如Amazon Redshift、Snowflake,适用于结构化数据分析)、数据湖(如Hadoop HDFS、Amazon S3,适用于存储原始多格式数据)或湖仓一体(Lakehouse)架构。

- 数据处理服务的作用:设计并实施最优的数据存储架构,进行数据分区、索引优化,并确保数据的安全性、可扩展性和高可用性。

5. 数据分析与建模

* 内容:这是提取洞察的核心阶段。运用统计分析、机器学习、深度学习等方法对数据进行探索和挖掘。

- 探索性数据分析(EDA):通过可视化、统计描述初步理解数据分布和规律。

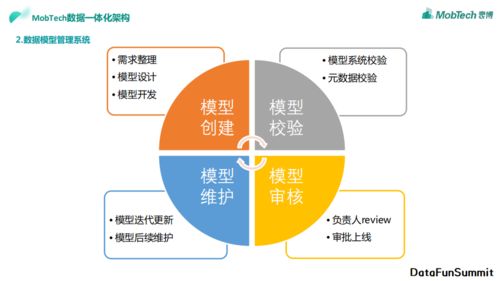

- 模型构建:根据业务目标,选择和应用合适的算法(如分类、回归、聚类、推荐)构建预测或描述模型。

- 模型训练与验证:使用训练数据训练模型,并用测试数据评估其性能,进行调优。

- 数据处理服务的作用:提供强大的计算平台(如Spark、Flink)和机器学习平台(如MLflow、Amazon SageMaker),支持数据科学家高效地进行特征工程、模型实验和迭代。

6. 数据可视化与部署应用

* 内容:将分析结果以直观的图表、仪表盘(Dashboard)或报告的形式呈现给决策者。将成熟的模型以API服务、嵌入式组件等形式部署到生产环境,实现实时预测或智能推荐。

- 数据处理服务的作用:提供可视化工具(如Tableau、Power BI、Superset)的部署和支持,并构建稳健的模型服务框架(如使用Docker、Kubernetes进行容器化部署),确保分析成果能够稳定、安全地服务于最终用户和业务系统。

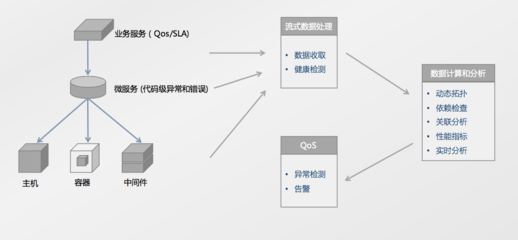

7. 监控与优化(闭环反馈)

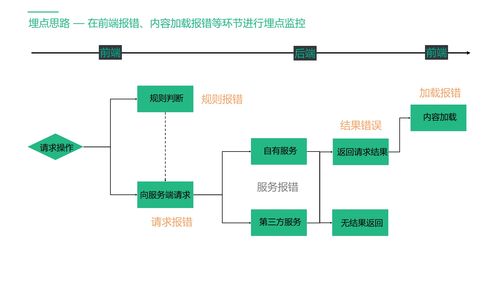

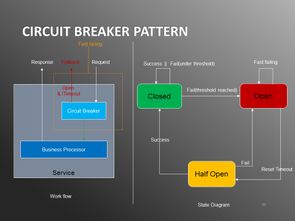

* 内容:分析流程并非一次性项目。需要持续监控数据质量、模型性能和业务指标,根据反馈和数据变化,重新调整目标、更新数据和优化模型,形成持续改进的闭环。

- 数据处理服务的作用:建立监控告警系统,对数据流水线、模型性能进行实时跟踪,并提供持续的运维和优化支持,保障整个分析系统的长效、健康运行。

二、数据处理服务:贯穿流程的价值赋能者

专业的“数据处理服务”并非仅指流程中的某一个环节,而是贯穿上述全流程的技术与能力支撑。其核心价值体现在:

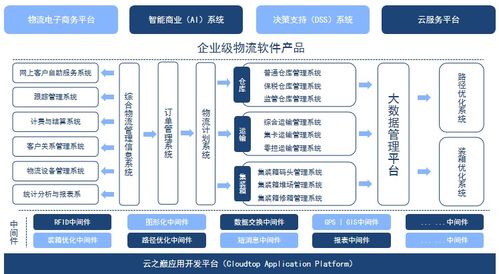

- 技术整合与平台化:将分散的大数据技术栈(Hadoop, Spark, Kafka, Flink等)整合为稳定、易用的企业级数据平台,降低技术复杂度。

- 流程自动化与工程化:将手动、临时的分析过程转变为自动化、可调度的数据流水线(Data Pipeline),提升分析效率和可重复性。

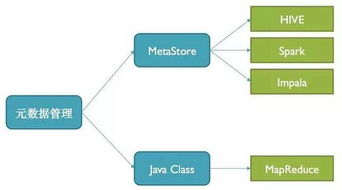

- 数据治理与质量保障:建立统一的数据标准、元数据管理和数据安全策略,确保数据的可信度与合规性。

- 赋能业务与降本增效:让业务人员和数据分析师能够更专注于分析和决策本身,而非底层技术细节,从而加速从数据到价值的转化过程。

****

大数据分析是一个系统性工程,其成功不仅依赖于先进的算法,更取决于一个设计精良、执行到位的流程。从业务理解到洞察交付,每一个步骤都至关重要。而专业的数据处理服务正是这一流程的“润滑剂”和“加速器”,它通过平台、工具和专家经验,确保数据能够顺畅、高质量地流经每个环节,最终驱动企业实现基于数据的智能决策与创新。

如若转载,请注明出处:http://www.weijiesong.com/product/21.html

更新时间:2026-05-30 02:56:24